Podczas gdy eksperci są w większości zgodni co do korzyści, jakie sztuczna inteligencja zapewni lekarzom – takich jak bardzo wczesne diagnozowanie chorób i przyspieszenie ogólnego doświadczenia w opiece zdrowotnej – niektórzy lekarze i naukowcy obawiają się, że zbyt szybko możemy zmierzać w kierunku praktyk medycznych opartych na danych.

Naukowcy obawiają się, że ludzie zbyt wiele oczekują od sztucznej inteligencji, zakładając, że może ona stworzyć rodzaj ogólnej inteligencji, którą posiadają ludzie, aby rozwiązywać szeroki zakres zadań.

„Wszystkie dotychczasowe zastosowania sztucznej inteligencji, które odniosły sukces, są niezwykle udane, ale mają bardzo wąski zakres zastosowań” — powiedział Bundy z Uniwersytetu w Edynburgu.

Według Bundy'ego te oczekiwania mogą mieć potencjalnie tragiczne konsekwencje dla branży takiej jak opieka zdrowotna. „Aplikacja do diagnostyki medycznej, która doskonale sprawdza się w przypadku problemów z sercem, może zdiagnozować pacjenta z rakiem z rzadkim rodzajem problemu z sercem, który może zakończyć się śmiercią” – powiedział.

Zaledwie w zeszłym tygodniu raport opublikowanej przez Stat publikacji poświęconej zdrowiu zacytował wewnętrzne dokumenty IBM pokazujące, że superkomputer Watson giganta technologicznego wydał wiele „niebezpiecznych i nieprawidłowych” zaleceń dotyczących leczenia raka. Zgodnie z artykułem oprogramowanie zostało przeszkolone w zakresie obsługi niewielkiej liczby przypadków i hipotetycznych scenariuszy, a nie rzeczywistych danych pacjentów.

„Trzy lata temu stworzyliśmy Watson Health, aby umożliwić sztuczną inteligencję sprostaniu niektórym z największych wyzwań w opiece zdrowotnej i jesteśmy zadowoleni z postępów, jakie czynimy” — powiedział CNBC rzecznik IBM.

„Nasza oferta w zakresie onkologii i genomiki jest wykorzystywana przez 230 szpitali na całym świecie i zapewniła opiekę nad ponad 84,000 2017 pacjentów, co stanowi prawie dwukrotność liczby pacjentów na koniec XNUMX r.”.

Rzecznik dodał: „Jednocześnie nauczyliśmy się i ulepszaliśmy Watson Health w oparciu o ciągłe informacje zwrotne od klientów, nowe dowody naukowe oraz nowe nowotwory i alternatywy leczenia. Obejmuje to 11 wydań oprogramowania zapewniających jeszcze lepszą funkcjonalność w ciągu ostatniego roku, w tym krajowe wytyczne dotyczące różnych nowotworów, od raka okrężnicy po raka wątroby”.

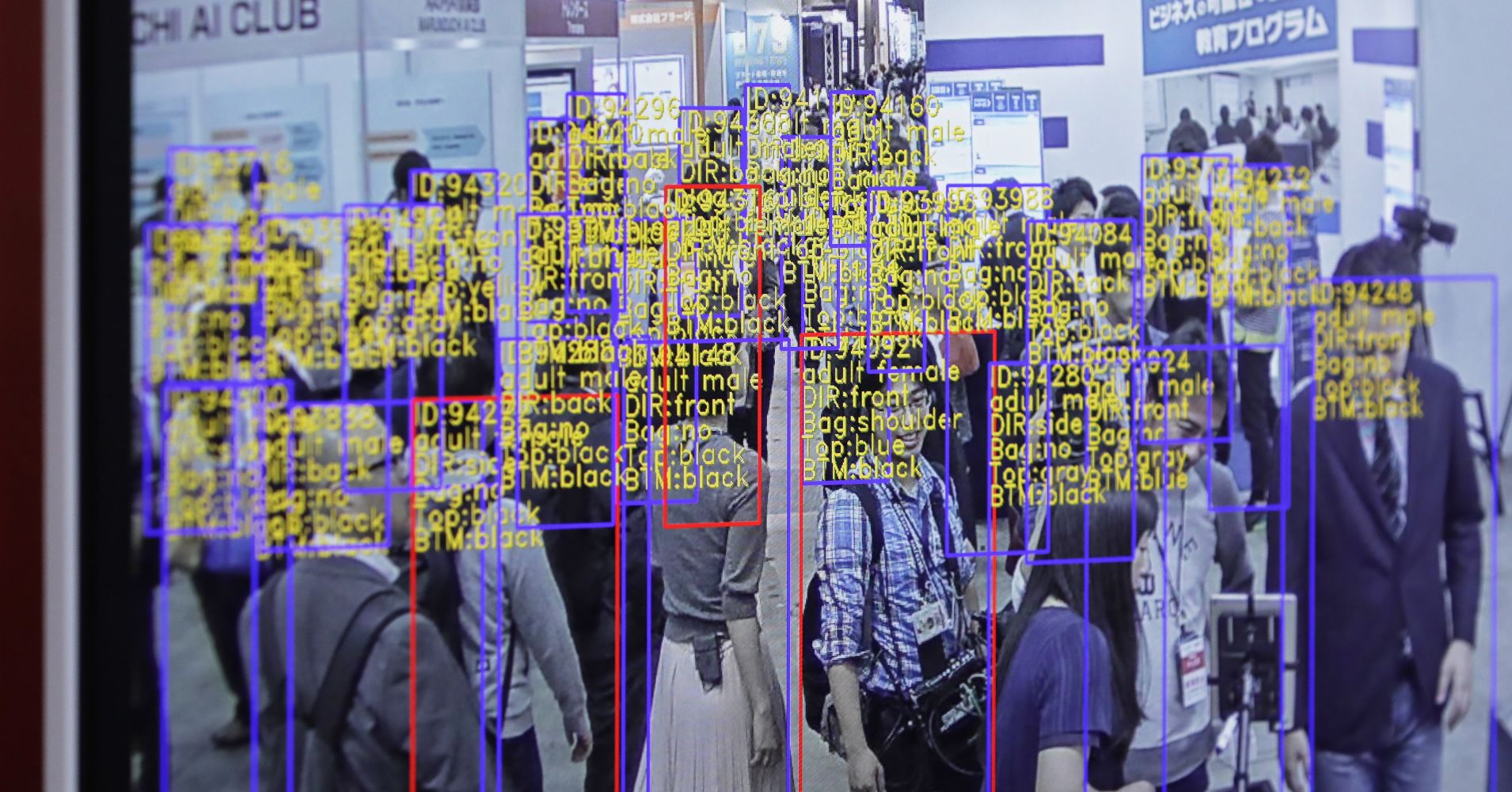

Innym problemem jest to, że ilość danych pochłanianych przez komputery i udostępnianych — a także algorytmy oparte na danych, które automatyzują aplikacje przy użyciu tych danych — może mieć etyczne konsekwencje dla prywatności pacjentów.

Początek big data, obecnie wielomiliardowej branży obejmującej wszystko, od handlu po hotelarstwo, oznacza, że ilość danych osobowych, które mogą być gromadzone przez maszyny, wzrosła do niewyobrażalnych rozmiarów.

Zjawisko to jest reklamowane jako przełom w mapowaniu różnych chorób, przewidywaniu prawdopodobieństwa poważnej choroby i badaniu leczenia z wyprzedzeniem. Jednak obawy o to, ile danych jest przechowywanych i gdzie są udostępniane, okazują się problematyczne.

Weźmy na przykład DeepMind. Firma AI należąca do Google podpisała umowę z brytyjską National Health Service w 2015 roku, dając jej dostęp do danych zdrowotnych 1.6 miliona brytyjskich pacjentów. Program oznaczał, że pacjenci przekazywali swoje dane firmie w celu poprawy zdolności jej programów do wykrywania chorób. Doprowadziło to do powstania aplikacji o nazwie Streams, która ma na celu monitorowanie pacjentów z chorobami nerek i ostrzeganie klinicystów o pogorszeniu się stanu pacjenta.

Jednak w zeszłym roku brytyjski organ nadzorujący prywatność, Information Commissioner's Office, orzekł, że umowa między NHS a DeepMind „nie jest zgodna z prawem o ochronie danych”. ICO stwierdziło, że londyński Royal Free Hospital, który współpracował z DeepMind w ramach umowy, nie był przejrzysty w kwestii sposobu wykorzystania danych pacjentów.

Signal2forex.com - Najlepsze roboty i sygnały Forex

Signal2forex.com - Najlepsze roboty i sygnały Forex